首创!第一人称电影解说AI模型震撼发布 | 原声克隆沉浸度100%

“注意看,这个男人叫小帅……” 这种第三人称解说曾经风靡一时,如今越来越多创作者开始尝试第一人称视角,直接以角色口吻讲述故事的爱恨情仇,在各大短视频平台收获百万点赞与粉丝。

第一人称解说不再是平铺直叙剧情梗概,而是深入人物内心,用细腻情感去共情观众。

这种沉浸感,正在让第一人称解说成为短视频平台的流量新宠,更是下一个内容创作的流量蓝海。

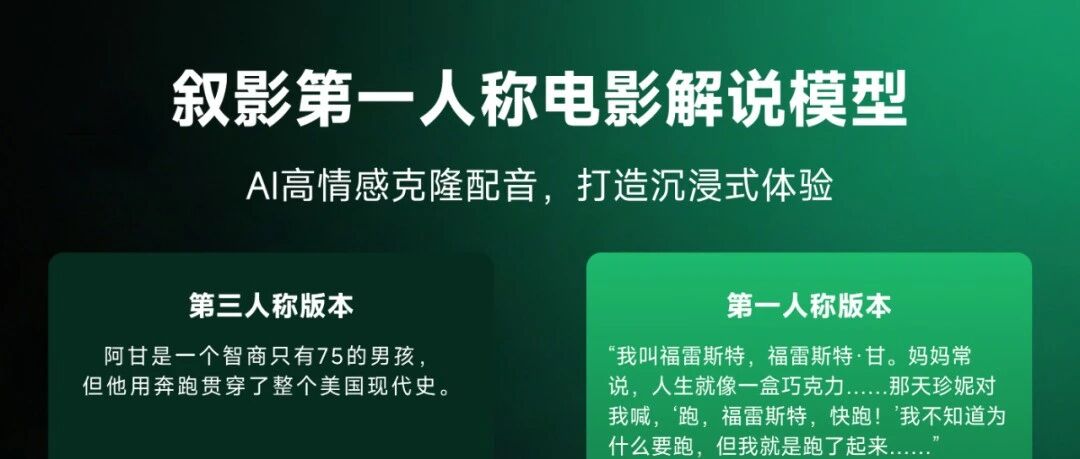

试想一下,我们来解说电影《阿甘正传》:

区别明显吗?左边,我们是冷眼旁观者;右边,我们就是阿甘,这种沉浸感远胜平铺直叙的旁白。

短视频创作者们即将迎来一款颠覆性的神器——「叙影·第一人称解说模型」。

我们重磅宣布:AI解说大师也能做这样的电影解说了!

而且更快、更稳,爆款脚本复刻、配音克隆一键搞定,全流程助力创作者打造沉浸式解说内容!

颠覆级解说神器:从解说故事,到成为主角

观众爱听故事,但更爱听故事里的“我”亲口讲出自己的故事。叙影模型正是抓住了这一点,让电影解说从“讲故事”升级为“演故事”。

「叙影·第一人称解说模型」让创作者用AI实现: ✅ 爆款解说脚本一键生成 ✅ 角色原音高情感克隆 ✅ 画面自动匹配智能精剪 从剧本到成片,全流程智能协作,一键搞定电影解说生产线。

1. 爆款脚本一键复刻:快速生成第一人称叙事文案

第一人称解说之所以抓人,很大程度在于剧本足够出彩。剧情选择、情感铺陈、叙事节奏,每一个爽点都拿捏到位。

然而要写出这样爆款文案并非易事,叙影模型借助海量优质解说文本的训练,吸收了众多爆款脚本的套路和精华。创作者只需给到爆款参考视频和想要代入的角色,模型便能自动生成符合第一人称视角的完整解说稿,复刻那些验证过的叙事节奏与爽点。

• 模仿爆款结构:学习爆款视频的叙事节奏、情绪曲线、经典钩子 • 代入角色视角:用“我”的口吻重组剧情 • 爽点密集排布:开头高冲突钩子 → 中段多重反转 → 结尾宿命升华 • 情感流畅递进:情绪高光和剧情推进同步,保证完播率

过去,这些需要多年经验和总结,现在,AI已经帮你学会了。叙影模型给你提供了一份“爆款蓝本”,大幅降低了优质脚本的创作门槛,哪怕是解说新手,也能像百万up主一样快速产出。

2. 原片角色音色克隆:为第一人称解说注入灵魂

在第一人称解说中,声音就是角色的灵魂。过去很多创作者只能退而求其次,使用剪辑软件内置的AI配音,然而这些声音选择非常有限,无非是几种系统预设音色,听久了难免有机械感、辨识度低。

叙影模型带来了革命性的升级:「角色音色克隆」技术。AI会根据原片中角色的台词语音来训练生成模型,使之输出与角色嗓音高度相似的配音。

我们对声音克隆的追求不止于“音色相似”,更在于情感契合。普通的AI配音往往平淡僵硬,而叙影的音色克隆力求还原角色说话时的情绪、语气乃至停顿节奏。我们用叙影模型和友商竞品效果,做一个对比:

这段程蝶衣的配音,不仅复现了张国荣先生独特的嗓音,还模拟出了蝶衣在不同剧情节点的情感张力——欢喜时的轻快、绝望时的哽咽都拿捏得恰到好处。

竞品的配音有浓浓的AI味,情感较低,无法体现角色独特个性。对比这些生硬冰冷的机械音,我们的角色配音听起来就像角色本人在诉说心声,让观众几乎忘了这是一段AI合成的声音。

角色音色克隆为第一人称解说带来质的飞跃,大大提升内容的吸引力和专业度。

3. AI智能精剪:语义秒配画面,剪辑不再“大海捞针”

最后还有一个让创作者头疼的环节:剪辑素材。解说者从几千个镜头里寻找与文案契合的画面,耗时耗力。

叙影团队深知剪辑环节的繁琐,因此同步研发了一项黑科技——AI智能精剪。可以理解为让AI替你看电影,自动挑选出与你旁白内容匹配的镜头并对齐时轴,实现音画一键混剪。

AI智能精剪包括以下几步:

• 多模态语义理解:当你的解说稿中写到“他眼中闪过一丝杀意”,系统解析定位,寻找出角色眼神中露出杀气的镜头。 • 画面检索:借助多模态视觉技术,识别人脸表情、动作场景。会在影片素材中自动搜索符合语义的片段,比如某个角色瞳孔骤缩、表情阴冷的特写镜头。 • 自动匹配:解说画面和配音精准同步,无需逐帧手动对齐。

以前可能需要两三天完成的解说视频,如今几个小时就能生成。平均节省70%以上的剪辑时间,效率大幅提升,剪辑准确度也更高——AI不会漏掉关键镜头,也不会因为疲劳而出错。

对于有规模产出切片需求的影视团队,智能精剪更是不可或缺的加速器,让批量生产优质内容成为可能。

一套「叙影」AI解说模型=文案专家+配音师+剪辑师+批量切片师,搭建了一套全自动流水线,让个体创作者拥有超级团队的生产力。

案例拆解:叙影模型如何打造《霸王别姬》第一人称沉浸式解说

通过案例,我们可以直观感受到叙影第一人称解说模型的强大之处:它就像一个经验丰富的专家,分析范例、提炼模式,然后快速地举一反三。

同样是“乱世悲剧”的题材,模型精准抓取角色的性格特点和剧情高光,会区别学习《鸿门宴传奇》中的虞姬和《霸王别姬》中的程蝶衣,让两位角色的自述各有独特的情感纹理用第一人称口吻重组故事。

最终输出的成片情绪曲线紧贴爆款,叙述流畅自然,背后是一整套Agent模型在并行协作:

在“节奏迁移”环节,叙影模型将爆款参考的结构和技巧迁移到了《霸王别姬》蝶衣的故事上:

角色代入式自我介绍:

以第一人称亮明身份+命运的方式开场。复刻了经典句式:我叫X,身份是...,却也...悲惨遭遇”,瞬间把读者带入角色命运。

整体采用严格的时间线推进,语言凝练而富有诗意,叙影模型牢牢捕捉到了其中的关键信息和叙事手法,这种“先抑后扬”的命运转折句式:先交代角色原本平凡或悲惨的处境,再点明一个关键事件如何改变了一切。

高冲突钩子开场:

爆款参考解说中,虞姬以“借刀”引出刺杀项羽的悬念暗示,《霸王别姬》解说词则在开篇呈现了小豆子被母亲狠心剁去一根手指的桥段。

两个场景都是极端暴力且情绪冲击强烈,一下子抓住观众眼球,达到类似的“黄金三秒”的效果。

“三幕式”悲剧结构:

解说词都遵循着相遇—共赴荣耀—殒命的三段式结构。虞姬从遇到项羽、并肩征战,到四面楚歌自刎殉情;蝶衣从遇到小楼、携手成名,到文革劫难孤台自尽。

叙影模型显然懂得,第一人称解说不仅要讲完故事情节,更要凸显角色情感线的完整起伏,让观众跟随角色经历高潮与低谷。

内心独白与行动并行:

爆款参考中虞姬在叙述中多次出现“如果重新选择…我还是会如何如何”的句式,叙影模型通过这种内心OS+当下行动的并列描述,让观众既能了解角色心理,又能紧跟剧情发展,代入感极强。

偶像化凝视的桥段如出一辙:虞姬之于项羽,如同蝶衣之于小楼,都是因对方的一次保护或鼓舞而认定了“追随一生”的信念。

宿命式结局升华:

两份解说词的结尾都用了对偶句式总结:这种“起于…终于…”的句法高度相似,点明了角色人生从一开始就注定了结局的不圆满,带给人无尽唏嘘。

可以说,叙影模型让蝶衣用几乎和虞姬一样的语调,说出了属于自己命运的那份叹息。

叙影模型在剧情节奏和语言模板两方面都实现了高度复刻:它承袭了爆款参考成熟的“爽点节拍”和情感曲线,再将《霸王别姬》的具体情节代入其中。

最终复刻的《霸王别姬》解说成片行云流水、起承转合有致,让人很难相信这是AI自动生成的。内容上既忠于电影情节,又以第一人称深挖了程蝶衣这个角色的内心世界,丝毫不逊色真人剪辑。

在这个过程中,模型背后的Agent协作引擎功不可没——不同AI Agent分别负责剧情理解、风格迁移、语言生成等工作环节,彼此协同配合,最终合力完成如此复杂的创作任务。这种多智能体分工让AI的创作更有条理、更可控,也更利于不断优化提升。

叙影模型并不是简单套壳,而是: ✅ 结构级迁移:保留虞姬稿的情绪起伏、节奏锚点 ✅ 情节级复刻:用蝶衣的“剁指”“空台诀别”对照虞姬的“借刀”“垓下殉情” ✅ 语言级适配:蝶衣版加入大量“台前-幕后”双空间描述,增强戏中戏张力 ✅ 情感级润色:强化“疯魔”主题,调整语速语调呼应剧情高潮

“复刻爆款”并不意味着千篇一律,而是让AI帮你打下扎实的叙事基础,再由你在此基础上自由发挥创意。

结语:你来做导演,AI负责跑流程

AI解说大师·叙影模型的出现无疑是令人振奋的。它让原本需要多人协作、多天打磨的影片解说生产流程大大简化:

从剧本到声音到画面,叙影模型已构建出一条AI驱动的沉浸式解说生产线。

- 一人、一台电脑,借助叙影模型就能轻松完成从策划文案、配音录制到剪辑成片,效果媲美专业团队。

- 支持批量生成素材,投流方、内容团队可快速孵化自有IP短视频矩阵

第一人称电影解说这种新兴的内容形式,在AI的加持下门槛更低、效率更高、质量更优,有望涌现出更多现象级的作品。